摘要:本文探讨了大型语言模型的胡话现象及其原因,分析了为何这些模型会出现幻觉。文章还探讨了如何拨乱反正,包括提高模型的准确性、加强数据清洗和预处理、优化模型结构等方面。通过深入研究,有助于更好地理解大型语言模型的运作机制,进而提升其在自然语言处理任务中的性能。

一、开篇引子

随着科技的飞速发展,人工智能大模型成为了新时代的宠儿,它们不仅能力超群,还时常展现出惊人的智慧,但有时,它们也会“说胡话”,让人摸不着头脑,难道这些大模型也有“幻觉”吗?我们就来聊聊这个话题,一起探究大模型背后的神秘面纱。

二、大模型为何“说胡话”?

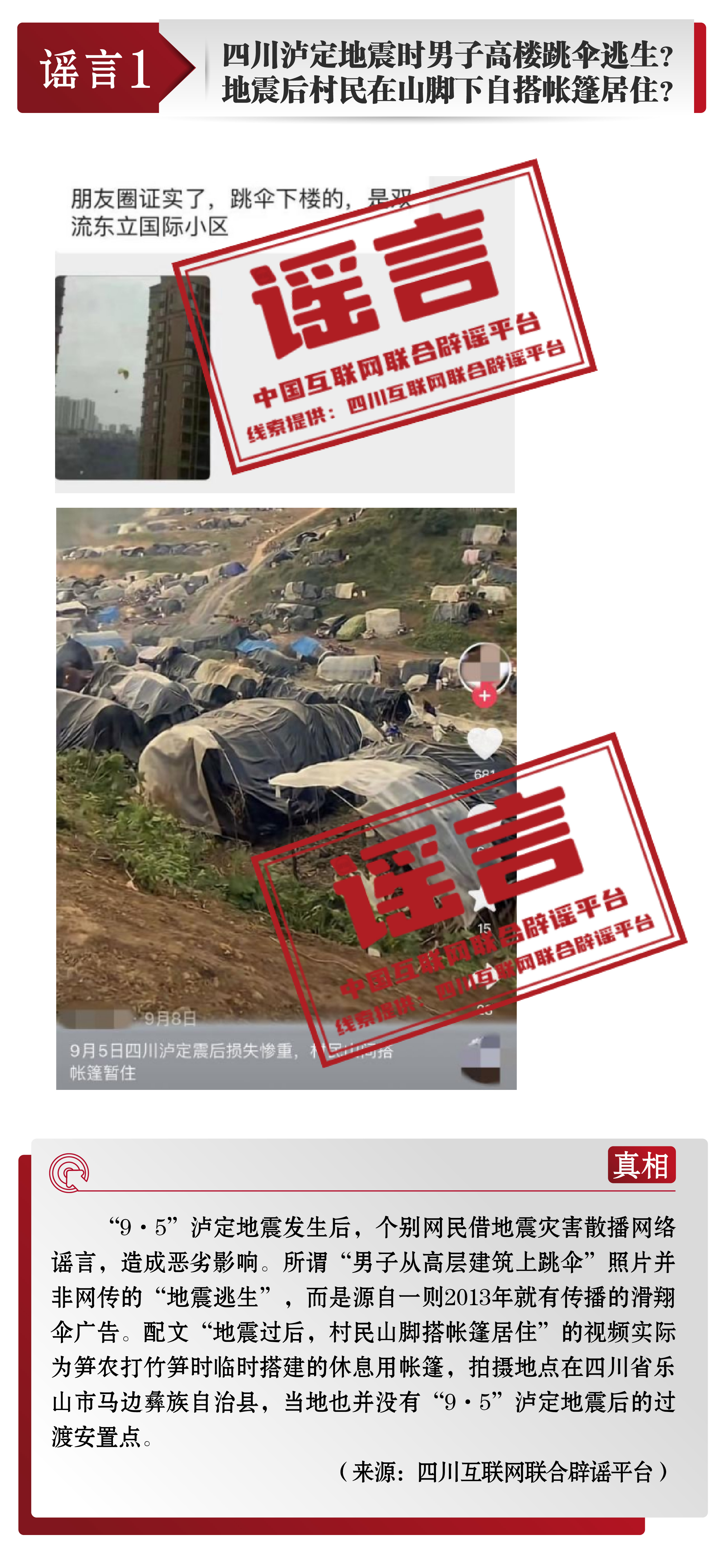

1、数据训练的不完全性:人工智能大模型是通过大量数据进行训练的,数据的来源广泛,质量参差不齐,其中可能存在错误或偏差,这些不完美的数据在训练过程中可能导致模型出现偏差,从而“说胡话”。

2、算法本身的局限性:目前的人工智能技术尚未达到完美境界,算法本身存在一定的局限性,在某些情况下,模型可能无法准确理解和处理复杂的信息,导致输出出现误差。

3、语境理解的挑战:语言是人类表达思想的重要工具,语境在其中起着关键作用,大模型在处理自然语言时,尽管能力强大,但在完全理解语境方面仍存在挑战,这可能导致其输出与预期不符。

三、大模型的“幻觉”问题解析

1、什么是大模型的“幻觉”?

当我们提到大模型的“幻觉”,通常是指模型在特定情境下产生的错误判断或输出,这些幻觉可能是由于上述提到的数据、算法等原因造成的。

2、“幻觉”问题的危害:

大模型的“幻觉”问题可能会引发一系列连锁反应,在自动驾驶领域,一个错误的判断可能导致安全事故;在医疗领域,错误的诊断可能危及患者生命,解决大模型的“幻觉”问题至关重要。

四、如何解决大模型的“说胡话”问题?

1、优化数据训练:针对数据训练的不完全性,我们可以通过优化数据质量、增加数据的多样性、提高数据标注的准确性等方法来减少模型的误差。

2、改进算法模型:针对算法本身的局限性,科研人员需要不断研究新技术,改进算法模型,提高模型的准确性和鲁棒性。

3、增强模型的上下文理解能力:为了提高模型对语境的理解能力,可以通过引入更多的上下文信息、改进模型的架构等方法来实现,还可以借助人类反馈循环来微调模型,使其更好地适应不同的语境。

4、加强监管与法规制定:政府和相关机构应加强对人工智能的监管,制定相应的法规和标准,确保人工智能的健康发展,企业也应承担起社会责任,确保人工智能产品的质量和安全性。

五、未来展望与结语

大模型的“说胡话”问题虽然存在,但随着科技的进步和研究的深入,我们有望解决这个问题,人工智能将更好地服务于人类,为人类带来更多的便利和福祉,让我们共同期待这一天的到来!

大模型的“说胡话”问题并非无法攻克的技术难题,只要我们认清问题的根源,采取合适的措施,就一定能够解决这个问题,娱乐生活之余,我们不妨多关注这些科技背后的故事,一起为科技的进步贡献自己的力量!

转载请注明来自徐州满江红科技有限公司,本文标题:《揭秘大模型的胡话之谜,为何出现幻觉?如何拨乱反正?》

京公网安备11000000000001号

京公网安备11000000000001号 京ICP备11000001号

京ICP备11000001号